Clayton Castelani

São Paulo, SP

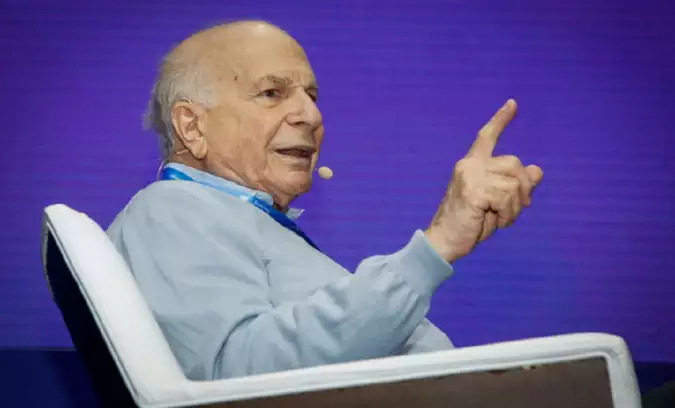

“As pessoas votam em candidatos que na verdade não são bons para elas”, disse nesta terça-feira (30) o psicólogo israelense Daniel Kahneman, prêmio Nobel de Economia, para uma plateia de empresários e investidores brasileiros que participavam de um evento da B3, a Bolsa de Valores brasileira, e da empresa de análise de dados Neoway, em São Paulo.

Kahneman usou o exemplo de uma eleição para explicar sua mais conhecida pesquisa sobre raciocínio e intuição, que resultou no best-seller “Rápido e Devagar – Duas Formas de Pensar” (ed. Objetiva, R$ 49,90).

Autoridade mundial em economia comportamental, o psicólogo afirmou que seres humanos podem até ser razoáveis em suas decisões, mas não são racionais do ponto de vista técnico, ou seja, não tomam decisões usando dados de forma estatística, como fazem os programas de computador.

Ainda retomando pontos de sua teoria, Kahneman explicou que há dois sistemas de pensamento. O primeiro é intuitivo e determina a maior parte das decisões humanas. É importante que esse sistema seja assim para a execução da maior parte das ações, como dirigir. Esse é o modo rápido de pensar.

“Não parece que é uma coisa que você está fazendo, parece que é algo que acontece com você”, disse.

Quando é necessário pensar profundamente sobre diferentes dados para tomar uma decisão, é o segundo sistema que entra em ação. É o pensamento mais lento que faz -ou deveria fazer- as escolhas complexas.

“Pensar devagar é algo que você faz. Algo que você demanda a si mesmo quando precisa resolver um problema”, disse.

Esse raciocínio lento, porém, não é natural e exige esforço. Por isso, na maioria das vezes, as pessoas delegam ao sistema que pensa rápido uma tarefa cuja complexidade exigiria uma avaliação mais demorada.

A escolha de candidatos que não representam os interesses de quem vota é um exemplo das consequências disso.

Kahneman ainda falou sobre as falhas no julgamento humano e o processo sistemático de decisões equivocadas tomadas em organizações, tema que ele trata no livro Ruído: uma falha no julgamento humano (ed. Objetiva, R$ 52,90), escrito em parceria com os professores Cass Sunstein e Olivier Sibony.

Preconceitos e emoções dos tomadores de decisões contaminam o processo decisório a ponto de transformar atividades técnicas em algo parecido com um bilhete de loteria, segundo Kahneman.

“Há um estudo nos Estados Unidos que mostra que juízes aplicam penas mais severas às segundas-feiras quando os times de futebol para os quais eles torcem perdem no fim de semana”, comentou.

Algoritmos desenvolvidos sobre uma extensa base de dados, por sua vez, podem amenizar o problema.

Kahneman ressaltou, porém, que a construção desses algoritmos contém premissas introduzidas por humanos e, por isso, não está necessariamente livre de vieses.

“Não é culpa do algoritmo, é culpa de quem criou o algoritmo. É preciso tomar muito cuidado com isso”, disse.

Ele também destacou os efeitos negativos das “decisões” tomadas por algoritmos no comportamento humano e, mais uma vez, citou disputas eleitorais.

Para Kahneman, a polarização política é um dos reflexos das escolhas feitas por algoritmos com base em pistas que os usuários deixam na internet.

“Nós estamos cercados por algoritmos e é claro que eles nos influenciam”, disse Kahneman.

“A Netflix acha que entende os meus gostos. Eu gosto de assistir a filmes e séries violentas quando estou fazendo exercícios pela manhã porque me fazem treinar mais rápido. Mas à noite eu não quero assistir a essas séries e a Netflix só me dá conteúdo violento. Às vezes, quando eu escolho algo mais inteligente, a Netflix me avisa que eu não vou gostar.”